L'intelligence artificielle avance à une vitesse fulgurante et ses capacités ont été décuplées ces derniers mois. Face à ces progrès spectaculaires : cette formation a été intégralement réenregistrée de A à Z pour coller à l'actualité brûlante de l'IA générative !

Pourquoi utiliser ComfyUI ?

ComfyUI est gratuit, open source et local.

- Gratuit : tant que votre ordinateur est capable de faire tourner les IA, vous pouvez générer autant que vous le désirez. Pas d'abonnement, pas de crédit, pas de limite.

- Open Source : ces outils ne sont pas propriétaires. Aucune chance que Google ou OpenAI les limitent, les censurent ou augmentent les prix lorsque la bulle de l'IA aura éclaté.

- Local : toutes vos créations, vidéos, images, restent strictement sur votre disque dur. Une fois que vous avez téléchargé les modèles, vous pouvez littéralement vous déconnecter d'internet et continuer à utiliser ces IA à volonté. Aucune fuite de données donc possible, vos images restent strictement confidentielles.

Cette nouvelle édition fait la part belle aux modèles révolutionnaires de nouvelle génération : Flux.2, Zimage, Qwen Edit, Wan ou encore LTX, qui sont aujourd'hui à la base de beaucoup d'outils payants en ligne.

Vous avez le contrôle : ComfyUI vous laisse construire vos propres workflows. Vous ne serez plus bloqués par les limites qu'une plate-forme peut vous imposer à tout moment.

Ce que vous allez apprendre dans cette formation Comfy UI :

- Installation et Maîtrise de l'interface : Découvrez les choix d'installation (ComfyUI Desktop, Portable) et apprenez à dompter l'interface en gérant vos templates, groupes et Subgraphs pour des workflows modulaires optimisés.

- Le Prompting intelligent avec les LLMs : Fini le syndrome de la page blanche ! Intégrez Ollama, Gemini, ChatGPT ou Ministral directement dans ComfyUI. Utilisez Florence pour analyser des images, créez des workflows automatisés (image vers prompt vers image) et décuplez la précision de vos requêtes.

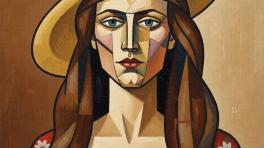

- L'Édition d'image absolue avec Qwen Edit : Découvrez le nouveau roi de l'édition open source. Apprenez à réunir des personnages, les intégrer dans un décor, rééclairer une scène, utiliser des images de référence, ou carrément manipuler une caméra virtuelle pour générer des vues sous différents angles.

- L'Upscale et la Correction Automatique : Maîtrisez les agrandissements parfaits avec Zimage Turbo ou SeedVR, et découvrez comment intégrer des IA propriétaires (Topaz, MagnificAI). Profitez de workflows automatisés pour corriger et ajouter des détails aux visages sans aucun effort.

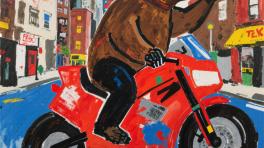

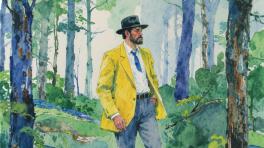

- Contrôle Total et Transfert de Style : Utilisez Canny et Depth pour imposer des contours ou récupérer la profondeur d'une image (idéal pour l'architecture). Découvrez Uso pour transférer un personnage dans une scène, appliquer le style d'une image à une autre, ou combiner plusieurs styles de manière inédite.

- La Révolution de la Vidéo IA : Un immense chapitre totalement nouveau dédié à la vidéo ! Transformez vos images et textes en animations fluides avec LTX et Wan. Contrôlez les mouvements de caméra avec WanCamControl, ajoutez des voix (TTS/Clonage), remplacez un personnage (Wan Animate), ou changez totalement le style d'une vidéo (Vace). Finalisez le tout avec l'interpolation Rife pour une lecture en 1080p parfaite !

- Les Modèles de pointe : Exploitez les capacités photoréalistes bluffantes et la parfaite représentation de texte du tout nouveau Flux.2, ainsi que d'autres modèles récents.

- Maîtrise des Loras : Utilisez le Lora Manager pour installer, empiler et équilibrer vos Loras afin d'imposer un style illustratif ou un rendu très spécifique à vos générations.

À qui s'adresse cette formation ?

Cette formation s'adresse à un public averti aux images générées par IA qui souhaite se libérer des limites des services en ligne payants (plus faciles à utiliser mais tellement plus bridés et chers). Vous possédez ici votre propre outil, que vous personnalisez comme il vous chante, avec des workflows hybrides à l'infini pour résoudre n'importe quelle situation créative.

Cette formation se concentre sur les modèles IA libres et gratuits.

Nano Banana, Seedream... sont accessibles par accès payant. Pour les apprendre, je vous conseille plutôt l'autre formation, sur ComfyCloud.

Prérequis matériels :

L'IA a énormément progressé, et ses exigences matérielles aussi. Pour faire tourner ces nouveaux modèles (comme Flux.2 ou les impressionnants générateurs vidéo) dans de bonnes conditions, il est conseillé d'utiliser un PC récent haut de gamme, équipé d'une carte graphique Nvidia possédant au moins 8 Go de VRAM (idéalement 12 Go, 16 Go ou plus).

Il est possible d'utiliser ComfyUI avec un Mac Apple Silicon récent avec de bonnes performances (M2 ou plus, version Pro ou Max), mais attention, certains outils spécifiques pourraient ne pas être compatibles.

Si vous n'avez pas le matériel adéquat, il existe Comfy Cloud, identique à la version locale, mais sur le web, et qui ne nécessite aucune installation.

Au final, vous aurez la même liberté et la même puissance qu'avec une version installée sur un super-ordinateur.

Je reste à votre disposition dans les salons pour toutes questions, n'hésitez pas !

Bonne formation !

Avis des apprenants