Découvrez comment utiliser Ollama pour exploiter la puissance des LLM en local, simplement, concrètement, et sans dépendre en permanence d’un service cloud.

Aujourd’hui, beaucoup de solutions d’intelligence artificielle reposent sur des abonnements, des limitations d’usage ou l’envoi de données vers des services en ligne. Pour de nombreux utilisateurs, cela devient vite coûteux, contraignant ou peu adapté à certains besoins. Avec Ollama, vous pouvez au contraire installer et utiliser des modèles d’IA directement sur votre propre machine, dans un environnement local, plus libre et plus maîtrisé.

Découvrez comment installer une IA locale sur votre machine grâceà ce tuto Ollama

Cette formation a été pensée pour les débutants qui veulent comprendre ce qu’est un LLM, découvrir l’IA locale et apprendre à utiliser Ollama de manière progressive, sans complexité inutile.

Dans cette formation, vous allez apprendre à :

- installer Ollama correctement,

- télécharger et lancer vos premiers modèles,

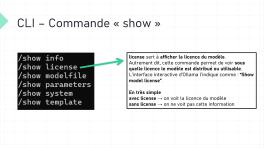

- utiliser le mode CLI interactif,

- mieux formuler vos prompts,

- comprendre le rôle du message système, du message utilisateur et du contexte,

- ajuster certains paramètres pour influencer le comportement du modèle

- créer un Modelfile simple,

- personnaliser le comportement d’un modèle,

- découvrir Msty, Open WebUI, VS Code et AnythingLLM

- explorer les premiers usages du RAG.

L’objectif de cette formation est de vous rendre rapidement autonome, avec une approche pratique et concrète.

Vous ne vous contenterez pas de découvrir Ollama : vous apprendrez à réellement l’utiliser, à mieux guider les réponses d’un modèle et à comprendre comment aller plus loin avec des outils complémentaires.

À la fin du cours, vous serez capable d’utiliser Ollama de manière autonome, de mieux exploiter un LLM local et de mettre en place vos premiers usages concrets autour de l’IA locale.